Ars-Technica

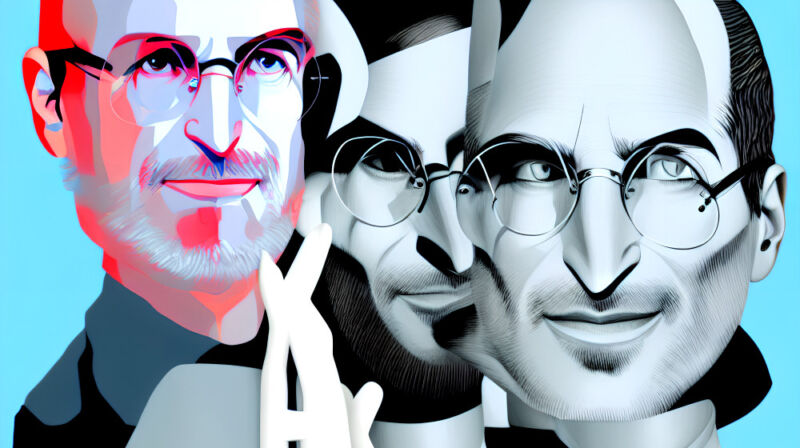

Una empresa de texto a voz con sede en Dubái ha lanzado un entrevista de podcast ficticio entre Joe Rogan y Steve Jobs utilizando voces realistas clonadas digitalmente de ambos hombres. Tiene lugar durante el «primer episodio» de una supuesta serie de podcasts llamada «Podcast.ai», creada por Play.ht, que vende servicios de texto a voz.

En la entrevista, primero escuchas una réplica de la voz de Rogan creada por una tecnología de clonación de voz similar a la que tenemos. portada en Ars. La tecnología de aprendizaje profundo ha permitido que los modelos de IA reproduzcan voces distintivas con un alto grado de precisión, como en el caso de Darth Vader en Disney. Obi Wan Kenobi Series de TV.

Para lograr este efecto, primero alguien debe entrenar el modelo de IA en muestras existentes de la voz que se clonará. Rogan es un objetivo principal para el entrenamiento de voz de IA a través de modelos de aprendizaje profundo porque existen grandes cantidades de su voz aislada en sus podcasts. De hecho, El borde cubierto un truco publicitario de una empresa de inteligencia artificial llamada Dessa que sintetiza a Rogan en 2019.

Donde este ejemplo de engaño de IA se vuelve más interesante es que Play.ht también expresó la voz del difunto CEO de Apple, Steve Jobs. Su voz, a veces robóticamente entrecortada, recuerda sus discursos de Apple y las entrevistas de All Things Digital de finales de la década de 2000. Y Play.ht afirma que el texto de la entrevista también fue generado por IA, posiblemente a partir de un modelo de lenguaje grande (LLM) similar a GPT-3.

«Las transcripciones se generan con modelos lingüísticos afinados», escritura Play.ht en el sitio Podcast.ai. «Por ejemplo, el episodio de Steve Jobs se entrenó en su biografía y todas las grabaciones de él que pudimos encontrar en línea para que la IA pudiera devolverlo a la vida con precisión».

De acuerdo con sus raíces LLM, la entrevista de 19 minutos no tiene mucho sentido. Después de un tiempo, partes de la entrevista ficticia comienzan a parecerse a mezclas conceptuales de puntos de conversación comunes de Jobs, que incluyen estética, productos innovadores, competidores como Google, Microsoft y Adobe, y triunfos de la Macintosh original.

Por ejemplo, durante parte de la entrevista, el falso Jobs ahonda en críticas a Microsoft que son muy similares a las que dijo el verdadero Jobs en una famosa entrevista de 1995 para triunfo de los nerds, pero no es una copia al carbón y puedes decir que la voz está sintetizada si comparas los dos. «Ese es el problema que siempre he tenido con Microsoft», dice Fake Jobs. «En muchos sentidos, son personas inteligentes y han hecho un buen trabajo, pero nunca han tenido gusto. Nunca han tenido sentido estético».

Queda por ver si es legal usar las semejanzas de voz de Jobs o Rogan de esta manera, particularmente para promocionar un producto comercial. Y a pesar de la naturaleza publicitaria del podcast, el concepto de podcasts de celebridades completamente ficticios llamó nuestra atención. A medida que la síntesis de voz se vuelve más extendido y potencialmente indetectable, imaginamos un futuro en el que los artefactos de los medios de todas las épocas probablemente sean completamente fluidos y maleables, moldeables para adaptarse a cualquier narrativa. En este particular mundo ficticio, Jobs es un gran admirador de Rogan.

«Es agradable sentarse en el auto y escucharte enfurecer», dice.