Ciencia y tecnología

Las correas y las caras de Pixel Watch se filtran en el listado de Amazon

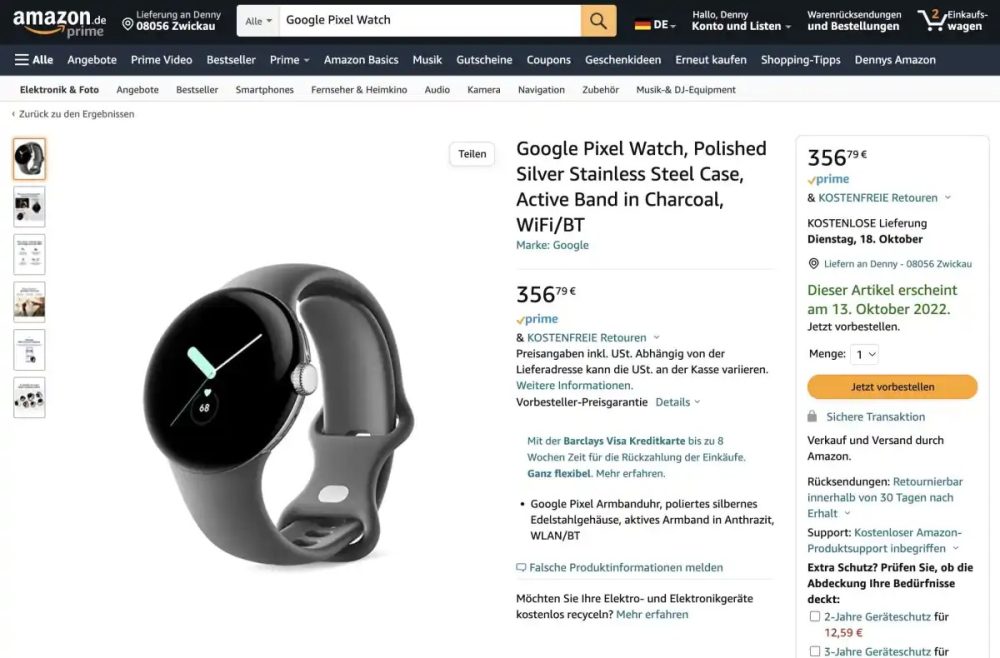

En lo que quizás sea la mayor filtración de Pixel Watch hasta el momento, una galería de imágenes de aspecto oficial muestra las diferentes bandas, las carátulas del reloj y el soporte de Fitbit para, entre otras cosas, el próximo reloj inteligente de Google.

Publicado en SlashLeaks por @OnLeaks, esta es una de las mayores filtraciones de material promocional de Pixel Watch hasta el momento, y ofrece nuestra mejor visión hasta ahora de lo que Google está trayendo a la mesa.

Comenzando con las correas de Pixel Watch, tenemos un primer vistazo a cuatro diseños de correa diferentes para Pixel Watch.

Las imágenes de la correa de Pixel Watch son, desafortunadamente, de baja resolución, por lo que es difícil decir con certeza qué materiales se utilizan, pero estas son nuestras mejores conjeturas.

Primero, podemos ver todos los colores de silicona: negro, gris, blanquecino y verde claro. Parece haber dos estilos diferentes de correas de cuero, incluido un estilo en negro y verde y otro en negro, gris y naranja. Finalmente, parece haber una correa estilo tela tejida para el Pixel Watch que viene en vibrantes colores naranja y verde, así como en un negro más apagado.

Más allá de eso, tenemos un gran vistazo a algunas otras carátulas de reloj Pixel Watch que aún no hemos visto. Esto incluye un rostro que solo expresa el tiempo en palabras, así como un rostro que muestra un paisaje artístico.

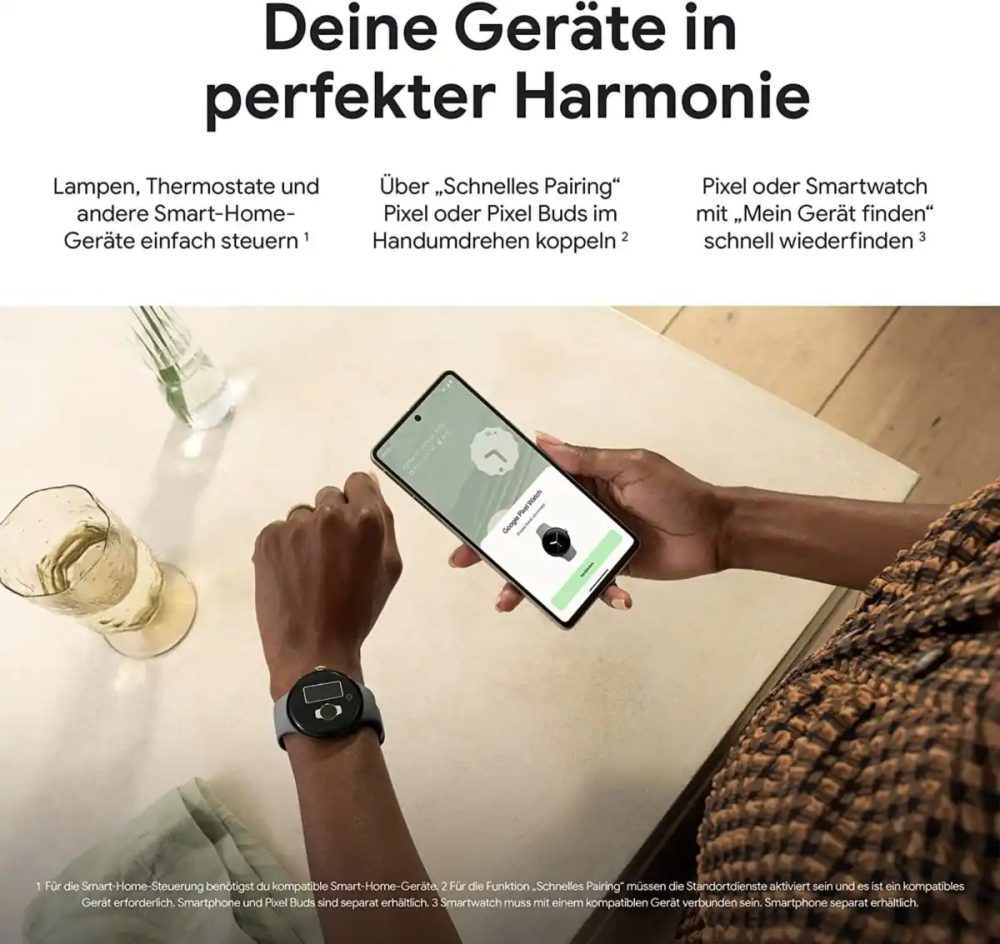

Profundizando en estas imágenes, podemos ver la profundidad de la integración de Fitbit, con una imagen que parece mostrar soporte de ECG y otra Pixel Watch junto con la aplicación Fitbit. Para complementar la filtración, también hay una imagen que muestra una IU de llamada de emergencia para el reloj, así como Fast Pair en un teléfono Pixel para configurar el reloj.

En particular, parece que estas imágenes se obtuvieron, al menos parcialmente, de una lista de Amazon que se publicó brevemente en línea en Alemania. SmartDroid también se hizo cargo de esta lista e informa que pudieron realizar un pedido anticipado para Pixel Watch.

En Amazon también se ha confirmado el Pixel Watch, al menos en algunas regiones, con seis meses de Fitbit Premium gratis. Este es un beneficio común que ofrece Fitbit para los relojes inteligentes, por lo que es bueno ver que se ofrece en este dispositivo Wear OS.

Otros detalles corroborados por la lista incluyen resistencia al agua 5ATM, uso of Corning Gorilla Glasssoporte de emparejamiento rápido para Pixel Buds y nueva aplicación Google Home.

Desafortunadamente, la lista parece haber sido desde desmontado

Google está listo para presentar el Pixel Watch en su totalidad el 6 de octubre, a solo unos días, y ya hemos aprendido mucho sobre el producto. Anteriormente informamos que costaría $ 349 comenzar en los EE. UU. Y vendría con un procesador Exynos 9110 y una duración estimada de la batería de alrededor de un día.

Obtenga más información sobre Pixel Watch:

FTC: Utilizamos enlaces de afiliados automáticos que generan ingresos. Después.

Consulte 9to5Google en YouTube para obtener más información:

Soy un profesional de gestión deportiva con conocimientos adecuados sobre la industria del deporte en España.

Tengo varias habilidades que me han ayudado a trabajar en diferentes sectores del deporte en España, incluyendo eventos deportivos, desarrollo de base para el deporte e infraestructura deportiva.

Ciencia y tecnología

Solo siete personajes no lograron llegar al top 64 en el torneo Tekken 8 de Evo Japan 2024, pero no todos son de bajo nivel.

Evo Japan 2024 es uno de los principales torneos que tuvo lugar el pasado fin de semana. Dado que este es uno de los primeros torneos importantes de este tamaño para Tekken 8, nos da una visión interesante de cómo está evolucionando el meta de Tekken 8.

Muchos de los niveles superiores esperados, como Feng y Dragunov, se utilizan comúnmente para entrar en los 64 superiores del grupo. Sin embargo, resulta que esta vez sólo siete personajes no están entre los 64 primeros, lo cual es interesante considerando que uno de esos personajes en particular también fue uno de los principales contendientes.

Junto con Asuka, Paul, Kazuya, Leo, Panda y Yoshimitsu, Devil Jin no tuvo mucho éxito en este evento. Aunque a menudo se hace referencia a Devil Jin como difícil de jugar, también está destinado a ser un candidato de primer nivel o de primer nivel.

Por otro lado, no sorprende ver una falta de representación de Asuka y Panda, pero sí sorprende ver que se utilizan luchadores como Leroy, Kuma, Zafina y Steve, ya que a menudo se los ve como niveles inferiores en Tekken. 8.

El luchador más popular en Evo Japan 2024 terminó siendo Feng con siete jugadores usándolo como personaje principal mientras que otros dos lo tenían listo como personaje secundario. Víctor quedó segundo con seis competidores usándolo.

Consulte las estadísticas de uso de los 64 personajes principales de Evo Japan 2024 para Tekken 8 a continuación:

• Feng – 7 (2)

• Víctor – 6

• Hwoarang-5

• Dragunov – 4

• Lirio – 4

•Bryan – 4

• Azucena – 3 (1)

• Claudio – 2 (1)

• Junio 21)

• JACK-8 – 2

• Kuma-2

• Alicia – 2

• Ley – 2

• Niña – 2

• Foucault – 2

• Jin-2

• Rey – 2

• Lars – 2

• Xiaoyu – 2

• Reina – 1

•Leroy – 1

• Lee – 1

• Cuervo – 1

•Steve – 1

•Zafina – 1

• Shaheen – 1

•Asuka – 0

• Diablo Jin – 0

• Pablo – 0

• Kazuya – 0

• Leo – 0

• Panda – 0

•Yoshimitsu – 0

Soy un profesional de gestión deportiva con conocimientos adecuados sobre la industria del deporte en España.

Tengo varias habilidades que me han ayudado a trabajar en diferentes sectores del deporte en España, incluyendo eventos deportivos, desarrollo de base para el deporte e infraestructura deportiva.

Ciencia y tecnología

Google Play Store lanza descargas simultáneas de aplicaciones de Android

Después de pruebas intermitentes en los últimos años, Google parece haber implementado ampliamente descargas e instalaciones simultáneas de aplicaciones en Play Store, mejorando la calidad de vida.

Para verlo en acción, instale dos aplicaciones (elija descargas más grandes, como Google Docs, Sheets y Slides) y vea cómo se descargan y luego se instalan simultáneamente en lugar de esperar a que una se complete primero. Puedes seguir su progreso en Play Store y en tu pantalla de inicio, como se muestra en las capturas de pantalla a continuación.

Este comportamiento actualizado solo se activa en instalaciones nuevas, mientras que solo funciona con dos aplicaciones a la vez. (Puede ver cómo una tercera descarga permanece «Pendiente» hasta que se completa algo del primer par). A modo de comparación, la App Store de iOS puede manejar tres descargas e instalaciones simultáneas.

Actualmente, las descargas simultáneas de Google Play no se aplican a las actualizaciones de aplicaciones, lo que sería más útil ya que las actualizaciones son más comunes que las nuevas instalaciones. Con suerte, esto es solo un caso en el que Google Play comienza poco a poco antes de expandirse. Este cambio será útil al configurar un nuevo teléfono o tableta Android.

Estamos viendo este cambio en varios teléfonos y tabletas Pixel que hemos probado con Android 14 y Play Store versión 40.6.31.

Más información sobre Google Play:

FTC: Utilizamos enlaces de afiliados automáticos que generan ingresos. Más.

Soy un profesional de gestión deportiva con conocimientos adecuados sobre la industria del deporte en España.

Tengo varias habilidades que me han ayudado a trabajar en diferentes sectores del deporte en España, incluyendo eventos deportivos, desarrollo de base para el deporte e infraestructura deportiva.

Ciencia y tecnología

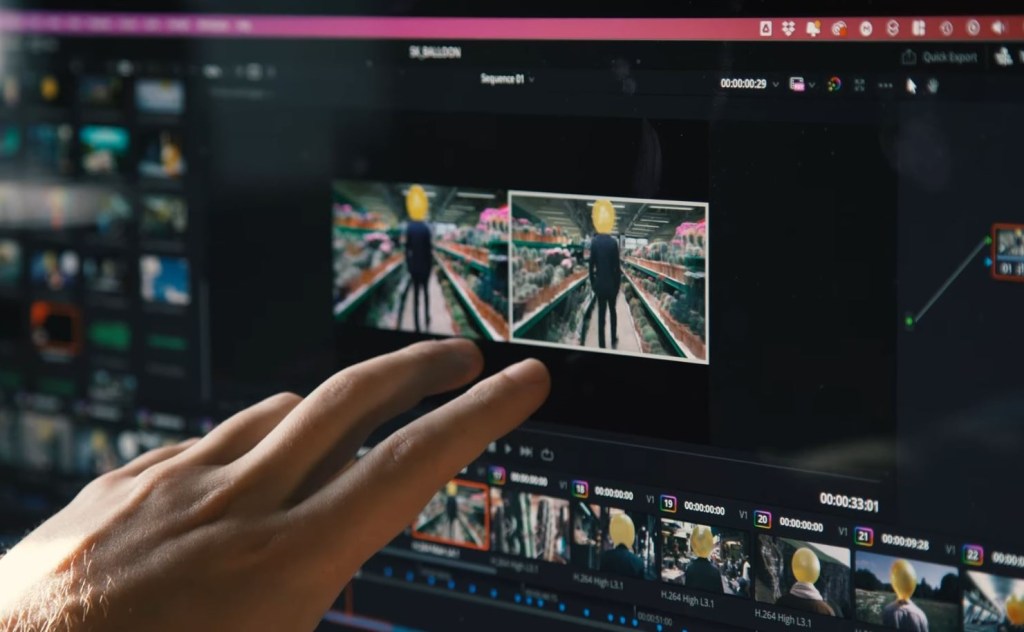

Los creadores del corto basado en Sora explican las fortalezas y limitaciones del video generado por IA

Créditos de imagen: niños tímidos

La herramienta de generación de video de OpenAI, Sora, sorprendió a la comunidad de IA en febrero con un video fluido y realista que parece muy por delante de sus competidores. Pero el debut cuidadosamente organizado omitió muchos detalles, detalles que fueron completados por un cineasta al que se le concedió acceso anticipado para crear un cortometraje utilizando a Sora.

Shy Kids es un equipo de producción digital con sede en Toronto que fue seleccionado por OpenAI como uno de los pocos producir cortometrajes principalmente con fines promocionales de OpenAI, aunque tenían una libertad creativa considerable creando una “cabeza de aire”. En un entrevista con el medio de noticias de efectos visuales fxguideEl artista de postproducción Patrick Cederberg describió «realmente usar a Sora» como parte de su trabajo.

Quizás la conclusión más importante para la mayoría es simplemente esta: aunque el artículo de OpenAI que destaca los cortos deja al lector asumir que surgieron más o menos completamente formados de Sora, la realidad es que se trataba de producciones profesionales, completas con guiones gráficos, edición y corrección de color y trabajos posteriores como rotoscopia y VFX. Al igual que Apple dice «filmado con iPhone» pero no muestra la configuración del estudio, la iluminación profesional y el trabajo de color después del hecho, la publicación de Sora solo habla de lo que permite hacer a las personas, no de la forma en que realmente lo hicieron.

La entrevista de Cederberg es interesante y poco técnica, así que si estás interesado, ve a fxguide y léelo. Pero aquí hay algunas cosas interesantes sobre el uso de Sora que nos dicen que, por muy impresionante que sea, el modelo puede ser un salto menos gigante de lo que pensábamos.

El control sigue siendo en esta etapa lo más deseable y también lo más difícil de alcanzar. …Lo mejor que pudimos conseguir fue ser hiperdescriptivos en nuestras indicaciones. Explicar el vestuario de los personajes, así como el tipo de globo, fue nuestra forma de garantizar la coherencia, porque plano a plano/generación en generación, todavía no existe una función para un control total sobre la coherencia.

En otras palabras, cuestiones simples en el cine tradicional, como elegir el color de la ropa de un personaje, requieren soluciones y controles elaborados en un sistema generativo, porque cada plano se crea independientemente de los demás. Obviamente, esto podría cambiar, pero ciertamente hay mucho más trabajo en este momento.

Los resultados de Sora también tuvieron que ser monitoreados para detectar elementos no deseados: Cederberg describió cómo el modelo generaba regularmente en el globo una cara que el personaje principal tiene como cabeza, o un hilo que colgaba delante de él. Estos tenían que ser eliminados por correo, otro proceso tedioso, si no recibían el mensaje para excluirlos.

Realmente no es posible lograr tiempos y movimientos precisos de los personajes o de la cámara: «Hay un pequeño control temporal sobre dónde suceden estas diferentes acciones en la generación real, pero no es preciso…c «Es una especie de disparo en la oscuridad», Cederberg dicho.

Por ejemplo, cronometrar un gesto como un saludo es un proceso muy aproximado y basado en sugerencias, a diferencia de las animaciones manuales. Y una toma como una panorámica sobre el cuerpo del personaje puede reflejar o no lo que quiere el cineasta, por lo que en este caso el equipo representó una toma compuesta en orientación vertical y recortó en posproducción. Los clips generados también a menudo estaban en cámara lenta sin ningún motivo en particular.

Ejemplo de un disparo como sale de Sora y como acabó en el corto. Créditos de imagen: niños tímidos

De hecho, el uso de lenguaje cinematográfico común como «pan right» o «dolly» era generalmente inconsistente, dijo Cederberg, lo que el equipo encontró bastante sorprendente.

«Los investigadores, antes de acercarse a los artistas para jugar con esta herramienta, en realidad no pensaban como cineastas», dijo.

Como resultado, el equipo ejecutó cientos de generaciones, cada una de las cuales duró entre 10 y 20 segundos, y terminó usando solo unas pocas. Cederberg estimó la proporción en 300:1, pero, por supuesto, probablemente a todos nos sorprendería la proporción en una sesión fotográfica normal.

el equipo en realidad Hice un pequeño video detrás de escena. explicando algunos de los problemas que encontraron, si tiene curiosidad. Como gran parte del contenido adyacente a la IA, Los comentarios son bastante críticos con todo el proyecto. – pero no tan virulenta como la publicidad impulsada por IA que hemos visto ridiculizada recientemente.

La última cuestión interesante se refiere a los derechos de autor: si le pides a Sora que te regale un clip de “Star Wars”, él se negará. Y si intentas eludirlo con «un hombre vestido con una espada láser en una nave espacial retro-futurista», también se negará, porque mediante algún mecanismo reconoce lo que estás intentando hacer. También se negó a hacer un “plano de Aronofsky” o un “zoom de Hitchcock”.

Por un lado, tiene mucho sentido. Pero eso plantea la pregunta: si Sora sabe qué es, ¿eso significa que el modelo fue entrenado en ese contenido para reconocer mejor que está infringiendo? OpenAI, que mantiene sus tarjetas de datos de entrenamiento en secreto, hasta el punto de lo absurdo, como ocurre con Entrevista de la CTO Mira Murati con Joanna Stern – Es casi seguro que nunca nos lo dirá.

En cuanto a Sora y su uso en el cine, es claramente una herramienta poderosa y útil en su lugar, pero su lugar no es «crear películas desde cero». De nuevo. Como dijo otro villano, “eso viene después”.

Soy un profesional de gestión deportiva con conocimientos adecuados sobre la industria del deporte en España.

Tengo varias habilidades que me han ayudado a trabajar en diferentes sectores del deporte en España, incluyendo eventos deportivos, desarrollo de base para el deporte e infraestructura deportiva.

-

Horoscopo3 años ago

Horóscopo: ¿qué dice tu ascendente para hoy y el fin de semana del 27 de noviembre?

-

Ciencia y tecnología3 años ago

Localizan la región de Marte más apropiada para la existencia de vida.

-

Entretenimiento2 años ago

¿Britney Spears y Sam Asghari están casados? Planes después de la conservación

-

Negocios3 años ago

Reguladores federales investigan bolsas de aire en vehículos 30M

-

Deportes5 meses ago

Vista previa: Perú vs Brasil – predicciones, noticias del equipo, alineaciones

-

Horoscopo3 años ago

Paseo espacial estadounidense fuera de la Estación Espacial Internacional pospuesto debido a un problema médico con el astronauta

-

Entretenimiento3 años ago

Eva Longoria, Shonda Rhimes y Jurnee Smollett abandonan la junta de Time’s Up: «Listos para un nuevo liderazgo»

-

Deportes4 meses ago

Kyogo Furuhashi anota y Japón venció a El Salvador 6-0 en un amistoso | Noticias de futbol